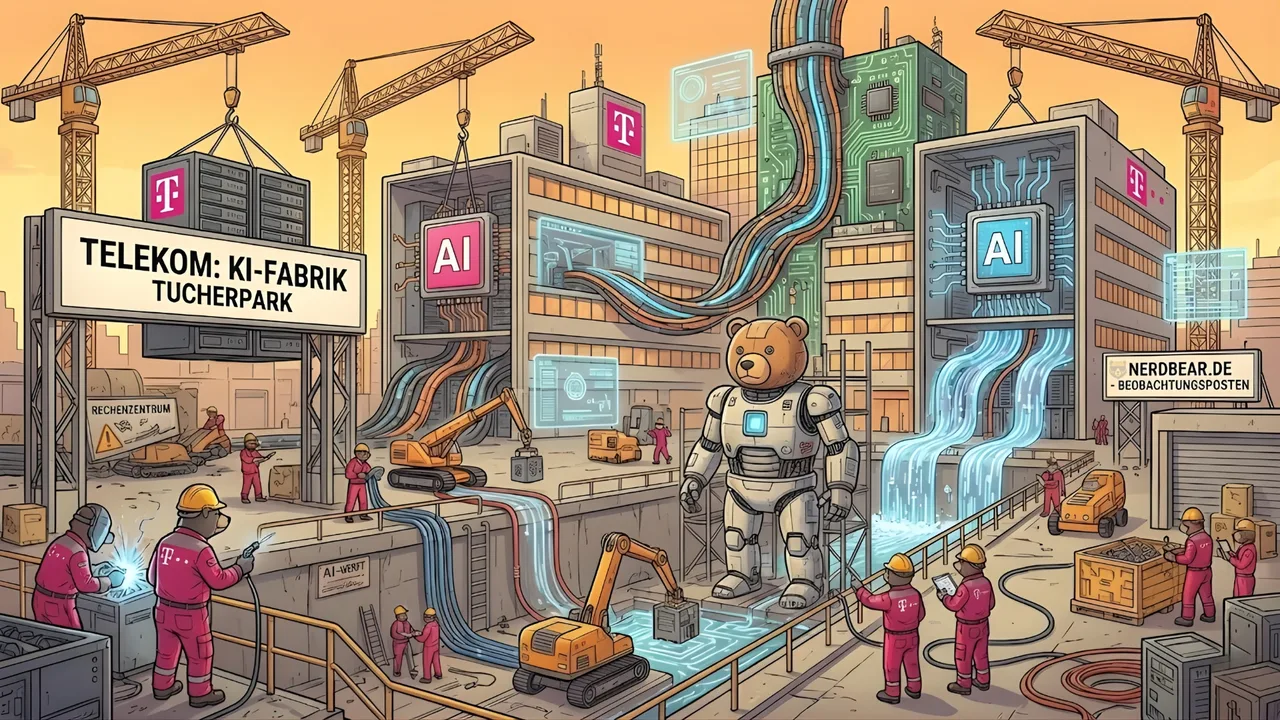

Moin, du da draußen. Setz dich mal mit mir an Deck, während der Wind über die Isar pfeift und die Möwen überm Englischen Garten kreisen. Heute reden wir nich über 'ne neue Cloud-Instanz oder 'nen weiteren Hyperscaler-Hype – heute geht's um 'ne echte Festung, die seit Anfang Februar 2026 im Münchner Tucherpark unter Deck liegt und der deutschen KI-Welt ordentlich Schub geben soll.

Der Startschuss

Höttges gibt Vollgas im alten Bank-Keller

Tim Höttges hat den Startschuss gegeben, zusammen mit Markus Söder, Lars Klingbeil und 'ner Handvoll anderer Prominenz. Was da unten in sechs Stockwerken unter der Erde steht, war früher mal 'n Rechenzentrum der Hypovereinsbank – entkernt, modernisiert, mit 150 Lkw-Ladungen Hardware bestückt und in gerade mal sechs Monaten hochgezogen. Polarise hat dat Ding gebaut, T-Systems betreibt's, Nvidia liefert die Kanonen und SAP den Deutschland-Stack obendrauf.

Technisch gesehen is dat 'ne 10.700-qm-Anlage mit rund 10.000 NVIDIA Blackwell-GPUs: DGX B200 SuperPods und RTX-PRO-Server mit je 96 GB ECC-Speicher. Im Vollausbau 0,5 ExaFLOPS KI-Rechenleistung – genug, sagt die Telekom, um theoretisch alle 450 Millionen EU-Bürger gleichzeitig 'nen Chatbot quatschen zu lassen. Aktuell schon zu über einem Drittel ausgelastet, erste Kunden wie Agile Robots und PhysicsX sind schon drin.

Die Takelage

Souveränität, Nachhaltigkeit und 'n paar clevere Tricks

Dat Ding läuft zu 100 % auf erneuerbaren Energien. Die Kühlung kommt direkt aus'm Eisbach – 'n moderner Weir leitet das kalte Wasser rein, die Abwärme geht später ins Fernwärmenetz und heizt das ganze Tucherpark-Quartier. 12 MW jetzt, Ausbau auf 20 MW geplant. Dat is kein grüner Anstrich, dat is echtes Engineering.

Dazu kommt der „Deutschland-Stack“: T-Systems liefert Infra und Plattform, SAP die Business-Technology-Platform und KI-Apps, Siemens bringt SIMCenter für digitale Zwillinge und GPU-beschleunigte Simulationen rein. Dat Ganze soll Mittelstand, Industrie und Staat 'ne sichere, regelkonforme Umgebung bieten – Daten bleiben in Deutschland, unter EU-Recht, keine automatische Weitergabe an US-Hyperscaler.

Und dann is da noch: Soofi, das große europäische souveräne Open-Source-LLM mit 100 Milliarden Parametern, das Leibniz-Uni Hannover und sieben weitere Forschungseinrichtungen plus zwei Startups auf genau dieser Infrastruktur trainieren wollen. Dat is der Moment, wo's ernst wird – endlich 'n eigenes Foundation-Model, das nich auf Llama oder GPT aufsetzt, sondern von Anfang an europäisch gedacht is.

Die kritische Brise

Is dat wirklich 'ne eigene Flagge oder nur 'ne neue Strömung?

Jetzt mal ehrlich: 10.000 Blackwell-GPUs sind beeindruckend, aber sie kommen alle von Nvidia – 'nem US-Konzern. Die Chips sind nich souverän, die Lieferkette is nich souverän, und wenn morgen 'n Exportverbot kommt, steht dat Ding da wie 'n Schiff ohne Segel. Dat is kein Vorwurf, dat is Fakt. Europa hat immer noch kein eigenes High-End-GPU-Ökosystem, und die Telekom kann dat auch nich aus'm Ärmel schütteln.

Zweitens: 0,5 ExaFLOPS klingen viel, aber im globalen Maßstab is dat immer noch 'n Tropfen auf 'n heißen Stein. Microsoft allein baut gerade Clusters mit Zehntausenden H100/H200, OpenAI und Meta ziehen nach. Deutschland steigt von 'nem sehr niedrigen Niveau aus – plus 50 % hört sich gut an, is aber immer noch weit hinter den Großen.

Drittens: Energie. Ja, Ökostrom und Abwärmenutzung – super. Aber KI-Training frisst Strom wie 'n hungriger Wal. Und wenn dat Ding erst richtig läuft und weitere Ausbaustufen kommen, wird der Bedarf explodieren. Ob dat alles wirklich nachhaltig bleibt, wenn ganz Deutschland plötzlich KI-Modelle trainieren will, muss sich noch zeigen.

Viertens: Soofi. Bisher is dat noch 'n Projekt auf dem Papier. Ob dat Modell wirklich gut wird, ob es die europäischen Sprachen und Industriedaten besser versteht als die US-Modelle, ob die Community es annimmt – dat steht alles noch in den Sternen. Viele ähnliche Initiativen sind schon im Sand verlaufen.

Und schließlich die große Frage: Wer bezahlt dat eigentlich? Über eine Milliarde Euro, größtenteils privat, aber mit politischer Rückendeckung und sicher auch 'ner Prise öffentlicher Förderung. Is dat 'ne echte Marktlösung oder doch wieder 'n staatlich subventionierter Versuch, den Anschluss nich zu verpassen?

Mein salziger Blick ins Logbuch

Trotzdem: Dat is der bisher konkreteste Schritt, den wir in Deutschland gesehen haben. Kein PowerPoint, kein Whitepaper, kein „wir planen bis 2030“ – sondern 'ne fertige Fabrik, die schon Kunden hat, schon läuft und schon Rechenleistung liefert. Dat is 'n Anker, an dem sich was festmachen lässt.

Ob dat reicht, um Europa wirklich souverän zu machen, hängt nich nur von der Telekom ab. Dat hängt davon ab, ob die Industrie dat Ding wirklich nutzt, ob die Forschung Soofi zum Fliegen bringt, ob die Politik die richtigen Rahmenbedingungen schafft und ob wir endlich aufhören, uns nur über Regulierung zu unterhalten, während anderswo die Clusters wachsen.

Für den Moment is dat 'ne starke Welle. Die deutsche KI-Flotte hat endlich 'nen eigenen Hafen mit ordentlich Tiefgang. Ob sie damit auch die hohe See erreicht, wird sich zeigen.

Logbucheintrag beendet. Kurs: vorsichtig optimistisch, aber stets auf Wache.